📌 논문 정보

- 제목: Attention Is All You Need

- 저자: Ashish Vaswani et al.

- 출처: arXiv (📄 논문 PDF)

- 게재일: 2017년 6월 12일, 최종 수정일 : 2023년 8월 2일

- 인용 횟수: 171,726회 (2025년 기준)

- 선정 이유: 트랜스포머(Transformer) 모델을 소개한 것으로, 현대 LLM의 핵심 구조를 이해하는 데 필수적 생각되어 선정

1. 서론: 트랜스포머의 등장 배경

기존 시퀀스 변환 모델은 주로 순환 신경망(RNN) 또는 합성곱 신경망(CNN)을 기반으로 했습니다.

이들은 인코더-디코더 구조를 통해 입력 문장을 출력 문장으로 변환했으며, 일부는 어텐션 메커니즘을 추가해 성능을 개선했습니다. 그러나 속도와 장기 의존성 학습에서 한계가 뚜렷했습니다.

이 논문은 순환 구조와 합성곱을 완전히 배제하고, 어텐션 메커니즘만을 활용한 트랜스포머 모델을 소개합니다. 이 접근법은 병렬 처리를 가능하게 해 훈련 속도를 높이고, 긴 문장의 의존성을 효과적으로 학습합니다.

2. 기존 모델의 한계

- RNN: 단어를 순차적으로 처리하므로 병렬 계산이 불가능하고, 긴 시퀀스에서 초기 정보가 손실되는 문제가 있었습니다.

- CNN: 고정된 커널 크기로 지역 정보를 처리하며, 멀리 떨어진 단어 간 관계를 학습하는 데 제약이 있었습니다.

- 어텐션의 필요성: 어텐션 메커니즘은 단어 간 순서에 상관없이 관련성을 계산할 수 있어, 이러한 한계를 해결하는 핵심 기술로 주목받았습니다.

트랜스포머는 어텐션을 중심으로 설계되어 기존 모델의 단점을 극복했습니다.

3. 트랜스포머 모델 구조

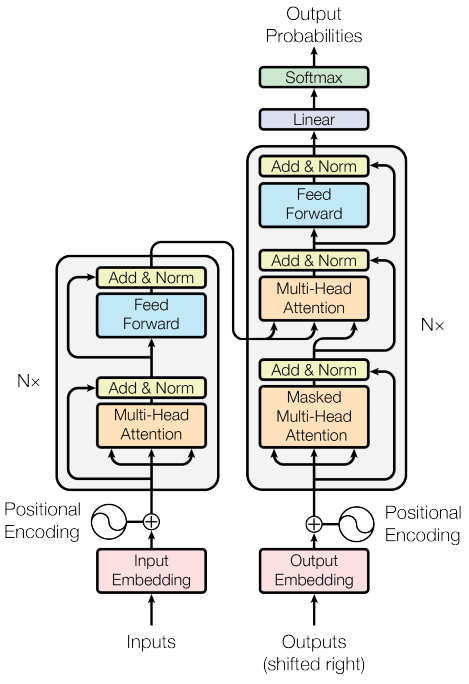

트랜스포머는 인코더와 디코더로 구성되며, 각각 6개의 레이어를 쌓아 설계되었습니다. 아래에서 각 구성 요소를 설명합니다.

3.1 인코더

- 멀티-헤드 자기-어텐션(Multi-Head Self-Attention): 입력 문장의 모든 단어가 서로 간 관계를 계산합니다. 이를 통해 단어 간 의존성을 파악합니다.

- 피드포워드 네트워크(FFN): 각 단어에 독립적으로 적용되어 추가적인 변환을 수행합니다.

- 잔차 연결(Residual Connection)과 레이어 정규화(Layer Normalization): 학습 안정성과 성능을 높입니다.

3.2 디코더

- 인코더와 유사한 구조를 가지며, 추가로 인코더 출력에 대한 어텐션 레이어가 포함됩니다.

- 마스킹(Masking): 자기-회귀 특성을 유지하기 위해, 출력 시퀀스의 미래 단어를 참조하지 않도록 제한합니다.

4. 어텐션 메커니즘

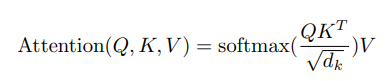

트랜스포머의 핵심은 Scaled Dot-Product Attention입니다.

4.1 계산 방식

- 입력을 쿼리(Query), 키(Key), 값(Value) 벡터로 변환합니다.

- 쿼리와 키의 내적을 통해 단어 간 유사도를 계산하고, 소프트맥스(Softmax)로 정규화한 후 값에 가중치를 적용합니다.

4.2 멀티-헤드 어텐션

- 단일 어텐션 대신 여러 개의 어텐션 헤드를 병렬로 사용합니다.

- 이를 통해 모델은 단어 간 다양한 관계를 동시에 학습하며, 표현력을 향상시킵니다.

5. 포지셔널 인코딩(Positional Encoding)

트랜스포머는 순환 구조가 없어 단어 순서를 자연히 반영하지 못합니다. 이를 보완하기 위해 포지셔널 인코딩을 도입했습니다.

- 사인(sin)과 코사인(cos) 함수를 사용해 단어의 상대적 위치 정보를 벡터에 추가합니다.

- 이는 "I like to eat"와 "Eat to like I" 같은 문장을 구분하는 데 필수적입니다.

6. 실험 결과

트랜스포머는 번역 작업에서 기존 모델을 압도하는 성능을 입증했습니다.

- WMT 2014 영어-독일어 번역: BLEU 점수 28.4 (기존 최고 모델 대비 2점 이상 향상).

- 영어-프랑스어 번역: BLEU 점수 41.8 (단일 모델 기준 최고 성능).

- 훈련 효율성: 병렬 처리로 RNN 대비 훈련 시간이 대폭 단축되었습니다.

이 결과는 트랜스포머가 번역 품질과 계산 효율성 모두에서 우수함을 보여줍니다.

7. 결론 및 의의

"Attention Is All You Need"는 트랜스포머를 통해 다음과 같은 기여를 했습니다:

- 장기 의존성 학습: 순환 구조 없이도 문맥을 효과적으로 이해.

- 병렬 처리: GPU 활용으로 훈련 속도 대폭 개선.

- 확장성: 번역 외에도 다양한 NLP 작업에 적용 가능.

이 논문은 이후 NLP 발전의 토대가 되었으며, BERT, GPT 등 현대 모델의 핵심 기술로 이어졌습니다. 트랜스포머는 오늘날 AI 번역, 챗봇, 텍스트 생성 등에서 널리 활용되고 있습니다.

마무리

이상으로 "Attention Is All You Need" 논문의 주요 내용을 정리했습니다. 트랜스포머의 구조와 작동 원리를 이해하는 데 도움이 되셨길 바랍니다. 추가로 궁금한 점이나 더 깊이 알고 싶은 부분이 있다면 언제든 질문 주세요. 다음 논문 정리에서 다시 만나겠습니다.

'LLM > LLM 논문 읽기' 카테고리의 다른 글

| 📝 LLM 논문 읽기 #3 - BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding (1) | 2025.03.25 |

|---|---|

| 📝 LLM 논문 읽기 #1 - A Survey of Large Language Models (1) | 2025.03.11 |